Настройка robots.txt для 1С-Битрикс

robots.txt контролирует, какие разделы сайта поисковые роботы могут сканировать, а какие — нет. Для Битрикс-сайта стандартный robots.txt «из коробки» обычно отсутствует или содержит только базовые запреты. Правильная настройка экономит краулинговый бюджет и исключает технические страницы из индекса.

Что закрывать для Битрикс-сайта

Технические пути, которые не должны индексироваться:

Disallow: /bitrix/

Disallow: /upload/iblock/

Disallow: /auth/

Disallow: /personal/

Disallow: /cart/

Disallow: /order/

Disallow: /search/?

Disallow: /catalog/*?*

Disallow: /?*

/bitrix/ — административная панель, ядро, кеш.

/upload/iblock/ — оригинальные изображения. Поисковику достаточно индексировать изображения через страницы товаров, не через прямые URL.

/catalog/*?* — страницы каталога с параметрами (сортировка, постраничная навигация). Исключение предотвращает индексацию дублей.

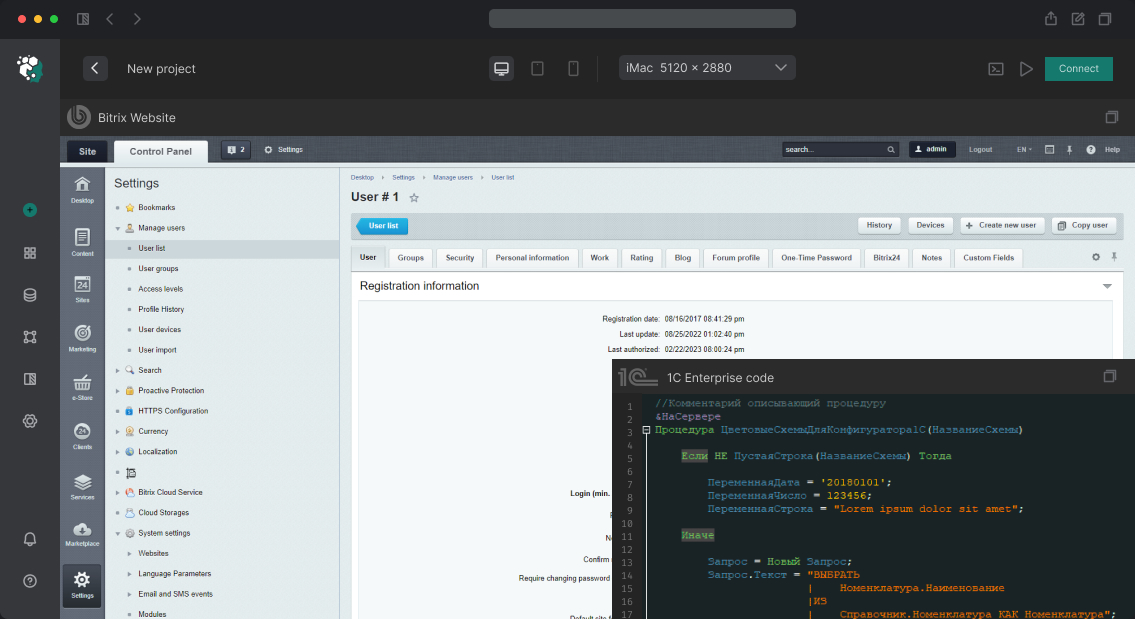

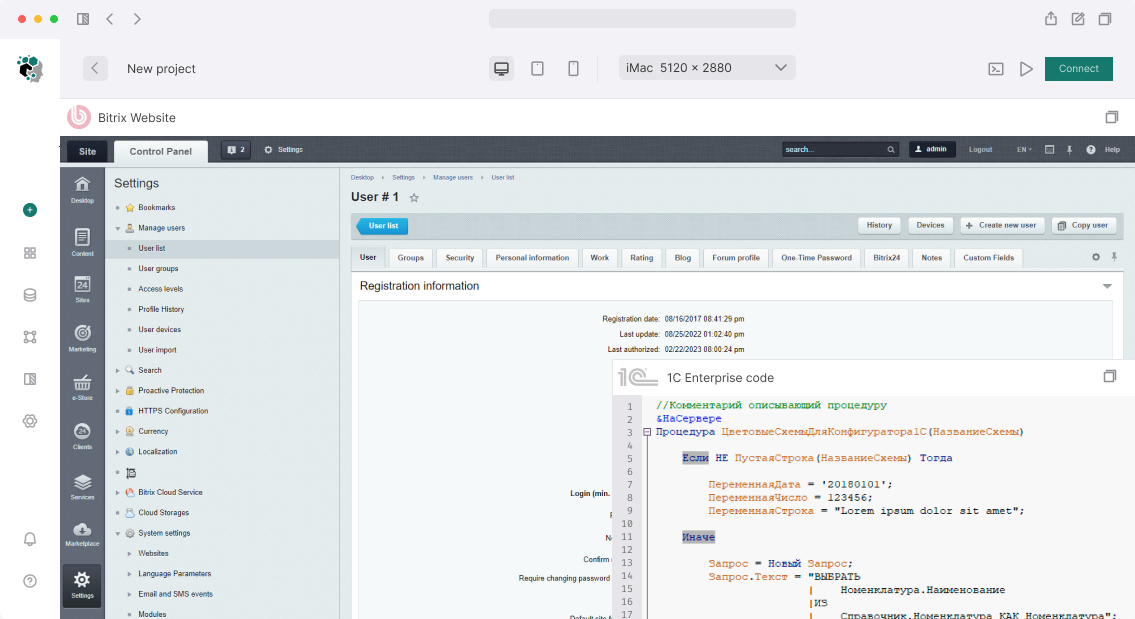

Управление через административную панель

В Битрикс нет встроенного визуального редактора robots.txt. Файл редактируется напрямую через Контент → Структура сайта → [корень] → robots.txt, либо по FTP/SSH.

Модуль seo добавляет ссылку на sitemap автоматически при генерации карты сайта. Проверьте, что в конце файла есть строка:

Sitemap: https://your-site.ru/sitemap_index.xml

Директивы для разных поисковиков

Яндекс и Google поддерживают директивы User-agent, Disallow, Allow, Crawl-delay и Sitemap. Для разных роботов можно задать разные правила:

User-agent: Yandex

Disallow: /catalog/*?*

Crawl-delay: 1

User-agent: Googlebot

Disallow: /catalog/*?*

User-agent: *

Disallow: /bitrix/

Disallow: /upload/tmp/

Disallow: /auth/

Crawl-delay: 1 для Яндекса — задержка 1 секунда между запросами. Используйте для сайтов на слабых серверах, чтобы краулер не перегружал хостинг.

Проверка результата

После внесения изменений проверьте файл через инструменты вебмастеров:

- Яндекс.Вебмастер → Инструменты → Анализ robots.txt

- Google Search Console → Инструменты → Тестирование файла robots.txt

Инструменты покажут, закрыт ли конкретный URL для конкретного робота.

Сроки выполнения

Составление и настройка robots.txt для типового Битрикс-сайта — 30–60 минут.